📌 この記事でわかること

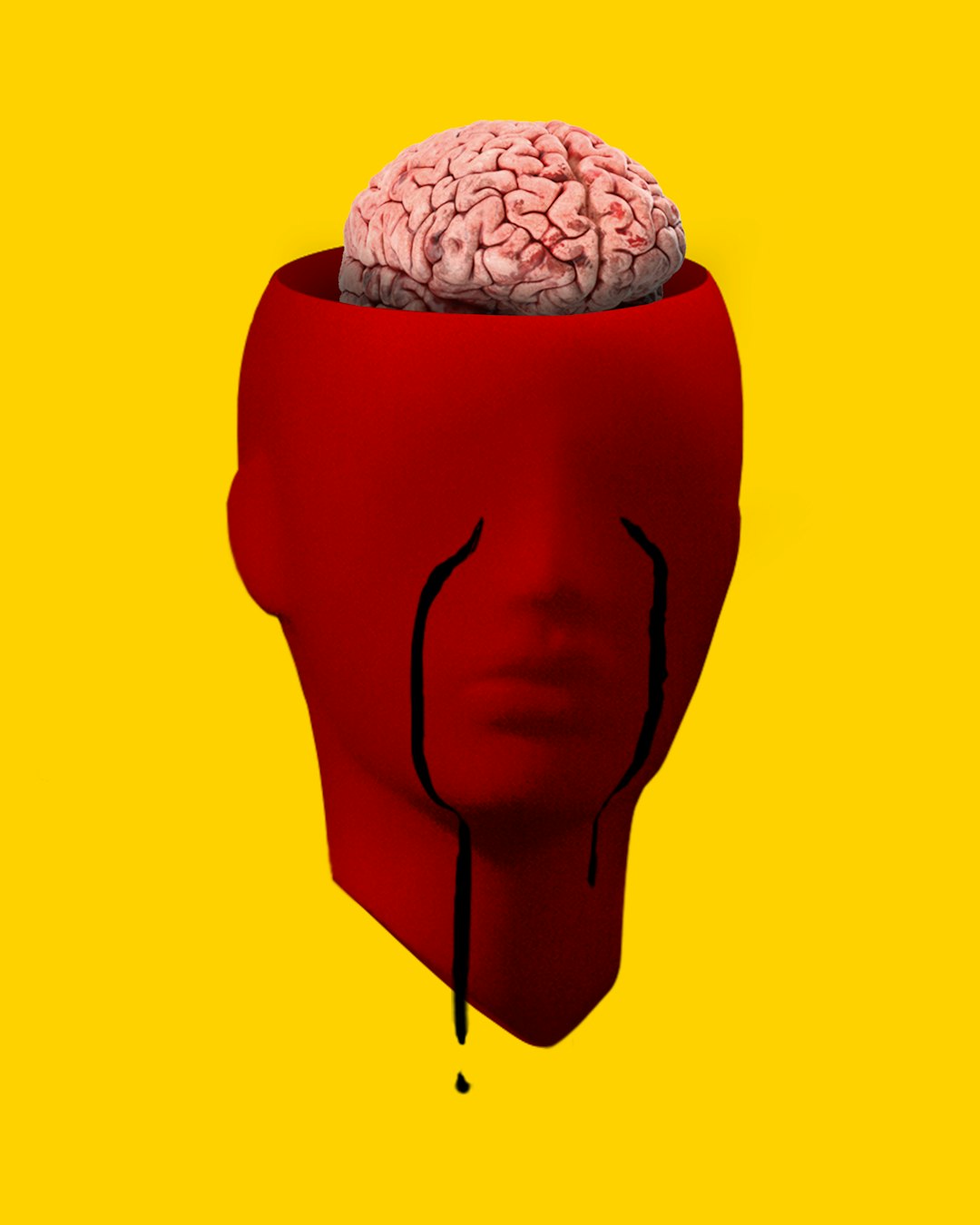

最新の研究で、AIのオートコンプリート機能が持つ恐るべき力が明らかになりました。これは、検索候補をわずかに偏らせるだけで、社会問題に対する人々の意見を密かに、そして強力に誘導できるというものです。この「デジタル・サブリミナル効果」の危険性について、日本のメディアはまだほとんど報じていません。

「便利」の裏に潜む見えない脅威

私たちが毎日何気なく使っている検索エンジンのオートコンプリート機能。文字を入力し始めると、AIが予測した検索候補が自動で表示される、あの便利な機能です。しかし、この裏側で、私たちの意見が静かに書き換えられているとしたらどうでしょうか。

最新の研究では、この機能が意図的に操作された場合の影響を調査する実験が行われました。研究チームは、参加者を複数のグループに分け、「経済格差はなぜ存在するのか」「自動化は雇用を増やすか減らすか」といった社会問題について検索させました。片方のグループには中立的な検索候補を、もう一方のグループには肯定的な、あるいは否定的な意見に偏った候補を提示したのです。

結果は衝撃的でした。偏った候補を提示されたグループは、そうでないグループに比べ、提示された方向に意見が大きく傾いたのです。これは、ユーザーが検索候補をクリックしなかった場合でさえ発生しました。ただ候補が「表示される」だけで、まるでサブリミナル効果のように、無意識のうちに人々の考えが形成されていたのです。

なぜ警告しても効果がないのか?

さらに恐ろしいのは、この心理操作の「防御不能性」です。研究チームは、実験参加者に対し「注意:このオートコンプリート機能はAIによって生成されており、偏見が含まれている可能性があります」という警告文を表示しました。しかし、驚くべきことに、警告は意見のシフトを全く防げなかったのです。

これは、人間の認知システムが持つ脆弱性を巧みに突いた「デジタル・サブリミナル効果」と呼べる現象です。私たちは、オートコンプリートで表示された候補を「世の中の多くの人が検索していること」だと無意識に認識してしまいます。たとえそれがAIによって意図的に生成されたものであっても、脳はそれを一種の「社会的証明」として受け入れてしまうのです。

意見の変化率

32.7%

偏向候補を提示された被験者グループ

つまり、ユーザーは「AIに操られた」のではなく、「自分の意思で情報を選択し、結論に至った」と錯覚します。このため、警告を与えられても「自分は大丈夫だ」と考え、影響を自覚することなく意見を歪められてしまうのです。これは、従来のプロパガンダやフェイクニュースとは全く異なる、より巧妙で検出困難な脅威と言えるでしょう。

日本社会に迫る3つのリスク

この技術が悪用された場合、日本のビジネスや社会にどのような影響が及ぶのでしょうか。考えられるリスクは主に3つあります。

第一に、選挙や国民投票における世論操作です。特定の政党や政策に有利な検索候補を大量に表示させることで、有権者の投票行動を水面下で誘導することが可能になります。人々は自らの意思で投票先を決めたと思い込んでいるため、外部からの介入に気づくことすら困難です。

第二に、消費者行動の巧妙な誘導です。「商品A 評判」と入力した際に「最高」「コスパ最強」といった候補ばかりが表示されれば、無意識のうちにその商品への好感度が高まります。逆に、競合他社の製品にはネガティブな候補を関連付けることも可能です。

第三に、ビジネスにおける意思決定の歪みです。市場調査や競合分析で検索エンジンを利用する際、偏った情報にさらされ続ければ、経営判断や投資判断を誤るリスクが高まります。これは、個人のスキルや経験だけでは防ぎきれない、新たなビジネスリスクの出現を意味します。

では、私たちはこの見えない脅威にどう立ち向かえばよいのでしょうか。最も簡単で、今すぐできる対策は「検索の仕方」を変えることです。単語をいくつか入力して候補から選ぶのではなく、「〜のメリットとデメリットは何か?」のように、具体的な質問として最後まで文章を入力する癖をつけることが重要です。

📝 この記事のまとめ

また、一つの情報源に頼らず、複数の検索エンジンや信頼できる専門サイトを比較検討することも不可欠です。AIが提供する「便利さ」を享受しつつも、常に一歩引いて情報を吟味する批判的な視点が、これからのデジタル社会を生き抜くための必須スキルとなるでしょう。

✏️ 編集部より

AIの進化は利便性をもたらす一方で、私たちの認知の脆弱性を突く新たなリスクも生み出しています。この記事で紹介された研究は氷山の一角に過ぎないと感じています。今後は、自らの思考プロセスを客観視し、AIが提示する情報を鵜呑みにしないデジタル・リテラシーが、ビジネスパーソンにとって必須のスキルになると注目しています。

コメントを残す